A Amazon Web Services (AWS) e a NVIDIA anunciaram a ampliação de sua parceria estratégica para entregar os mais avançados serviços, infraestrutura e software capazes de acelerar as inovações de Inteligência Artificial (IA) generativa a seus clientes. As empresas juntarão as tecnologias da NVIDIA e da AWS – desde os mais novos sistemas NVIDIA multinós com GPUs, CPUs e software de IA de última geração até a virtualização e segurança do AWS Nitro System, a interconexão do Elastic Fabric Adapter (EFA) e a escalabilidade do UltraCluster, ideais para o treinamento de modelos fundacionais e a construção de aplicações de IA generativa.

Os principais serviços anunciados foram:

- Novas instâncias Amazon EC2

A AWS será o primeiro provedor de cloud a oferecer os Superchips NVIDIA GH200 Grace Hopper com a tecnologia multinós NVLink na nuvem. A plataforma conecta 32 Superchips Grace Hopper às tecnologias NVIDIA NVLink e NVSwitch em uma instância e estará disponível no Amazon Elastic Compute Cloud (Amazon EC2), conectada com os dispositivos de rede da AWS (EFA), suportados por virtualização avançada (AWS Nitro System) e clustering de hiperescala (Amazon EC2 Ultraclusters), permitindo que clientes conjuntos escalem para milhares de Superchips GH200. As instâncias AWS com GH200 NVL32 darão aos clientes acesso sob demanda para desempenho de nível de supercomputador, algo crítico para cargas de trabalho de IA/ML em larga escala, que precisem ser distribuídas ao longo de múltiplos nós para complexas cargas de trabalho de IA generativa – incluindo FMs (modelos fundacionais), sistemas de recomendação e bancos de dados vetoriais.

- AWS é a primeira a hospedar a NVIDIA DGX Cloud rodando o Grace Hopper

A AWS irá hospedar a NVIDIA DGX Cloud, plataforma de treinamento em IA como serviço, proporcionando às organizações acesso rápido à supercomutação multinós e acelerando o treinamento dos mais complexos LLMs e modelos de IA generativa, com o software NVIDIA AI Enterprise integrado e acesso direto aos especialistas em IA da NVIDIA – oferecendo aos desenvolvedores a maior memória compartilhada em uma única instância, capaz de chegar a mais de 1 trilhão de parâmetros.

- Desenvolvimento de IA na NVIDIA

A NVIDIA e a AWS estão colaborando no Projeto Ceiba para desenvolver o mais rápido supercomputador de IA baseado em GPU, sistema em escala com GH200 NVL32 e interconexão Amazon EFA. O primeiro supercomputador desse tipo – com 16.384 Superchips NVIDIA GH200 e capaz de processar 65 exaflops de IA – será utilizado para impulsionar a próxima onda de inovação em IA generativa. O supercomputador será integrado a serviços da AWS como a solução de rede criptografada Amazon Virtual Private Cloud (VPC) e o serviço de storage de alta performance Amazon Elastic Block Store. A NVIDIA utilizará o supercomputador para avançar em IA para LLMs, gráficos e simulação, biologia digital, robótica, carros autônomos, previsão do clima no Earth 2 e muito mais.

- Desenvolvimento de IA generativa, HPC, design e simulação

A fim de estimular o desenvolvimento, o treinamento e a inferência dos maiores LLMs, as instâncias P5e da AWS utilizarão a mais recente GPU H200 da NVIDIA para oferecer 141 GB de memória GPU HBM3e, que é 1,8x maior e 1,4x mais rápida do que as GPUs H100.

A AWS também anunciou novas instâncias Amazon EC2 G6e com GPUs NVIDIA L40S e instâncias G6 com GPUs L4 para entregar soluções com eficiência energética para cargas de trabalho de gráficos, IA e vídeo.

As instâncias G6 foram construídas para lidar com cargas de trabalho complexas, como IA generativa e aplicações de gêmeos digitais. Com o NVIDIA Omniverse é possível desenvolver, contextualizar e aprimorar simulações 3D realistas utilizando dados em tempo real.

- Software NVIDIA na AWS acelera o desenvolvimento de IA generativa

O software NVIDIA na AWS está ajudando a Amazon a trazer mais inovações aos seus serviços e operações. A AWS está usando o framework NVIDIA NeMO para treinar LLMs Amazon Titans selecionados. O Amazon Robotics começou a usar o NVIDIA Omniverse Isaac para construir gêmeos digitais para automatizar, otimizar e planejar seus centros de distribuição autônomos em ambientes virtuais antes de implementá-los no mundo real. O NVIDIA BioNeMO, disponível agora no Amazon SageMaker e planejado para ser oferecido na AWS por meio do NVIDIA DGX Cloud, permite que empresas farmacêuticas acelerem o descobrimento de medicamentos ao simplificar e acelerar o treinamento de modelos utilizando seus próprios dados.

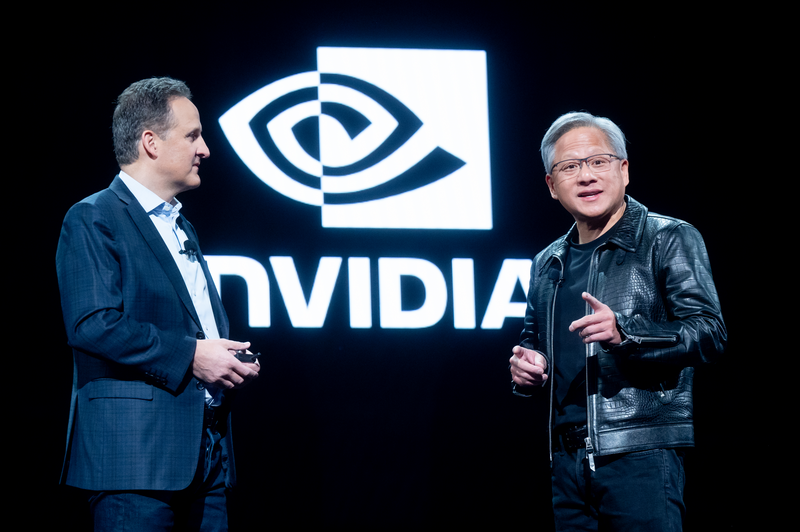

“A IA generativa está transformando os workloads em nuvem e colocando a computação acelerada no centro da geração de conteúdos diversos”, disse Jensen Huang, fundador e CEO da NVIDIA. “Conduzidos pela missão comum de entregar o estado da arte em IA generativa, com eficiência de custo para todos os clientes, a NVIDIA e a AWS estão colaborando ao longo de toda a cadeia de computação, incluindo infraestrutura de IA, bibliotecas de aceleração, modelos fundacionais e serviços de IA generativa.”

“A AWS e a NVIDIA trabalham em conjunto há mais de 13 anos, começando pela primeira instância GPU em nuvem. Hoje, oferecemos a mais ampla gama de soluções GPU da NVIDIA para cargas de trabalho como gráficos, jogos, computação de alto desempenho, machine learning e, agora, IA generativa”, disse Adam Selipsky, CEO da AWS. “Continuamos inovando com a AWS para torná-la o melhor lugar para se rodar GPUs, combinando a próxima geração de Superchips NVIDIA Grace Hopper com as capacidades de rede do AWS EFA, de clustering em grande escala do EC2 UltraClusters e de virtualização avançada do Nitro.”